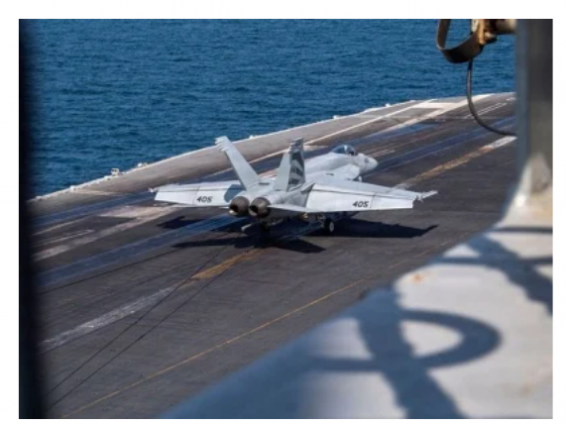

Минобороны США официально приняло «этические принципы» использования искусственного интеллекта в сфере вооружений. Вашингтон заявил, что будет руководствоваться пятью основными нормами: «ответственностью», «объективностью», «контролепригодностью», «надёжностью» и «управляемостью». В Пентагоне подчеркнули, что созданием такого свода положений США демонстрируют всему миру «приверженность этике» и намерение «играть ведущую роль в обеспечении демократии». Однако эксперты считают, что решение создать подобный список — это очередная попытка навязать другим странам мира свои правила, а также контролировать их выполнение в одностороннем порядке. При этом сам Вашингтон не привык следовать принципам этики в военной сфере, отмечают аналитики.

В Министерстве обороны США сообщили, что официально приняли «этические принципы» использования искусственного интеллекта (ИИ) в сфере вооружений.

«Применение искусственного интеллекта существенно изменит характер вооружённых конфликтов будущего, однако ничто не изменит американской непоколебимой приверженности ответственному и законопослушному поведению. Принятие этических принципов использования ИИ укрепит стремление министерства к поддержанию высочайших нравственных норм, закреплённых в стратегии Министерства обороны США в отношении искусственного интеллекта», — приводит слова главы Пентагона Марка Эспера пресс-служба американского оборонного ведомства.

Предполагается, что Пентагон будет руководствоваться пятью основными принципами при использовании искусственного интеллекта в военной сфере: «ответственностью», «объективностью», «контролепригодностью», «надёжностью» и «управляемостью».

Как сообщает американское оборонное ведомство, в основу «этических принципов» использования искусственного интеллекта в военной сфере «лягут существующие у ВС США этические рамки».

«(Они. — RT) опираются на Конституцию Соединённых Штатов, раздел 10 Кодекса США, Руководство (американского Минобороны. — RT) по правилам ведения войны, существующие международные договоры и устоявшиеся нормы и ценности», — говорится в заявлении оборонного ведомства.

Пентагон объясняет необходимость следования таким «этическим принципам» тем, что «применение ИИ приводит к возникновению новых неоднозначных и потенциально опасных вопросов этического характера».

Как отметил председатель Совета по оборонным инновациям Эрик Шмидт, создание свода таких «этических принципов» показывает миру, что Вашингтон примет активное участие в контроле за деятельностью других стран в сфере использования искусственного интеллекта.

Как отмечает эксперт Международного института гуманитарно-политических исследований Владимир Брутер, утверждение Пентагоном «этических принципов» — «простое и незамысловатое продолжение той гегемонистской политики, которую США проводят по всем направлениям».

«К демократии это никакого отношения не имеет. Это всё лишь говорит о том, что Соединённые Штаты опять пытаются создать некую систему, которая будет работать по принципу «хайли лайкли». При этом Вашингтон будет навязывать её всем и определять, кто и как её нарушает», — заявил аналитик в разговоре с RT.

Брутер также подчеркнул, что никакие «этические принципы» не могут обезопасить человечество от угроз, исходящих от искусственного интеллекта.

«Есть только один путь — это использование подобных технологий в меру, рационально и со смыслом, на что Вашингтон не всегда бывает способен», — отметил эксперт.

Заведующий кафедрой международных организаций и мировых политических процессов факультета мировой политики МГУ Андрей Сидоров, в свою очередь, утверждает, что Пентагон составил такой список «этических принципов» «исключительно в пропагандистских целях».

«Так Вашингтон пытается убедить собственное население, а также другие страны мира, что активизация США в области использования искусственного интеллекта в сфере вооружений отвечает морально-этическим принципам», — отметил аналитик в беседе с RT.

При этом Сидоров подчеркнул, что «сами по себе» принципы, разработанные американской стороной, «абсолютно бесполезны», поскольку являются «расплывчатыми».

«Они не содержат никакой даже морально-этической нагрузки, не говоря уже о юридической. Исходя из этих положений, не становится понятнее, кто и как будет наказан, если искусственный интеллект, например, будет использован против человека, против отдельных государств. Мне кажется, американцы и сами этого не понимают», — подчеркнул эксперт.

При этом глава Пентагона, рассказывая об «этических принципах», также заявил о необходимости повысить скорость внедрения ИИ.

«США совместно с нашими союзниками и партнёрами должны ускорить внедрение искусственного интеллекта и активнее других использовать его в целях национальной безопасности, чтобы поддерживать наши стратегические позиции, побеждать на полях сражений будущего и защищать международный порядок, основанный на правилах», — подчеркнул Марк Эспер.

Стоит отметить, что Пентагон не впервые выступает с заявлением о необходимости ускорить внедрение искусственного интеллекта в военную сферу. При этом предлогом для таких изменений выступает зачастую «российская угроза».

Так, в начале ноября 2019 года Марк Эспер обвинил Москву в готовности использовать системы искусственного интеллекта «против демократических стран».

«Мы ожидаем, что Россия будет использовать всё более сложные системы искусственного интеллекта в нынешних и будущих зонах боевых действий», — отметил министр обороны США во время конференции по искусственному интеллекту в Вашингтоне.

Эспер также подчеркнул, что Соединённым Штатам необходимо предотвратить доминирование «авторитарных» стран в этой области. По словам главы Пентагона, на фоне угроз со стороны Москвы и Пекина американская сторона должна наращивать преимущество в сфере искусственного интеллекта.

«Страна, которая первой пожнёт плоды искусственного интеллекта, получит решающее преимущество на поле боя на многие годы вперёд. Мы должны прийти к этому первыми», — сообщил министр.

Однако российская сторона не раз заявляла, что развивает технологии в военной области исключительно в оборонительных целях.

«Россия хочет иметь полноценные, равноправные и дружеские отношения с США. Россия никому не угрожает, а все наши действия в сфере безопасности носят исключительно ответный, а значит, оборонительный характер. Мы не заинтересованы в конфронтации и не хотим её» — заявил президент России Владимир Путин в феврале 2019 года во время ежегодного послания к Федеральному собранию.

Напомним, 11 февраля 2019 года президент США Дональд Трамп подписал указ об усилении развития искусственного интеллекта в Соединённых Штатах.Согласно документу,Вашингтон будет стимулировать разработку технических стандартов в этой области, а также снижать барьеры для безопасного тестирования и внедрения технологий ИИ. Кроме того, в указе отмечается, что необходимо укрепить доверие общественности к использованию искусственного интеллекта, а также осваивать эту нишу на мировом рынке.

На следующий день после публикации указа Пентагон обнародовал краткое содержание стратегии использования искусственного интеллекта, которая направлена, в частности, на противодействие РФ и КНР в данной области. Указывается, что инвестиции этих стран в развитие искусственного интеллекта «угрожают подорвать технологические и операционные преимущества» США, а также «дестабилизировать свободный и открытый международный порядок».

После публикации этой стратегии Пентагон действительно активизировался в области внедрения искусственного интеллекта в военную сферу, отмечают эксперты.

Об этом, в частности, говорит весенняя заявка на исследование Министерства армии США, с текстом которой ознакомился RT. В ней указывается, что Пентагон планирует изучить потенциал маневрирования систем с искусственным интеллектом и возможности их совместной работы с военными «перед лицом равного по потенциалу противника».

По мнению аналитиков, действия американской стороны по развитию технологий искусственного интеллекта для военных нужд «могут нести угрозу мировой безопасности».

«Вашингтон скоро начнёт внедрять такие технологии везде и всюду. Однако сверхактивное использование искусственного интеллекта в вооружениях представляет особую опасность», — полагает Владимир Брутер.

По его словам, если «чрезмерно передавать функции человека машине, искусственный интеллект может повести себя непредсказуемо и стать неуправляемым».

«Ведь никто не знает, как он проявит себя в сложившейся обстановке», — подчеркнул эксперт.

При этом Андрей Сидоров указывает, что ситуация обостряется ещё и из-за того, что «проблема использования искусственного интеллекта» до конца не изучена даже в научной сфере.

«Когда создавалось ядерное оружие, оно разрабатывалось с благими целями, а в конечном итоге стало угрозой для всего мира. Ту же судьбу могут повторить и технологии искусственного интеллекта», — отметил аналитик.

Владимир Брутер, в свою очередь, подчеркнул, что этические правила вряд ли каким-либо образом ограничат США в использовании искусственного интеллекта, поскольку Вашингтон «никогда не придерживался этических правил в военной сфере».

«США попросту к этому не привыкли. Зато среди желающих насадить свою волю «мягкой» или «твёрдой» силой они первые», — заключил эксперт.

16:22

15:14

13:17

12:55

22:56

19:06

14:35

14:16

13:49

09:23

09:03

13:48

13:15

13:00

12:17

17:40

16:55

14:17

13:49

12:02

09:46

13:07

23:54

23:49

11:17

10:52

20:20

18:38

16:05

15:04

14:28

16:22

16:11

13:18

12:59

10:45

09:03

20:33

13:39

13:55

10:35

17:02

16:25

13:08

10:49

09:53

19:15

18:48

18:38

17:16

| Вс | Пн | Вт | Ср | Чт | Пт | Сб | |

| 1 | 2 | 3 | 4 | 5 | |||

| 6 | 7 | 8 | 9 | 10 | 11 | 12 | |

| 13 | 14 | 15 | 16 | 17 | 18 | 19 | |

| 20 | 21 | 22 | 23 | 24 | 25 | 26 | |

| 27 | 28 | 29 | 30 | ||||

16:17

10:00

12:58

15:39

09:49

13:25

14:04

12:51

15:28

12:39

13:24

13:02

12:39

15:08

11:15

14:33

12:26

11:23

13:25

15:19

14:27

15:16

12:13

15:14

14:44

13:25

11:06

13:12

11:13

14:15

11:26

09:35

11:41

10:37

10:55

12:28

12:13

12:51

11:35

10:45

16:51

10:21

14:27

12:37

11:23

13:03

10:47

13:03

13:15

14:58